Thương nhân trong cuộc dẫn số liệu thống kê cho thấy số lượng ứng dụng AI và website cung cấp công cụ “cởi đồ” phụ nữ ngày càng gia tăng. Người dùng chỉ cần tải lên một bức ảnh bình thường của một người, AI sẽ trả về bức ảnh khỏa thân của người đó sau vài giây.

Theo công ty phân tích truyền thông xã hội Graphika, một nhóm gồm 34 trang web cho phép “cởi quần áo” bằng AI đã thu hút 24 triệu lượt truy cập trong tháng 9. Dữ liệu từ Sameweb cũng cho thấy, trên các mạng xã hội như X và Reddit, nội dung chứa link giới thiệu đến các website, ứng dụng này đã tăng hơn 2.000% từ đầu năm đến nay.

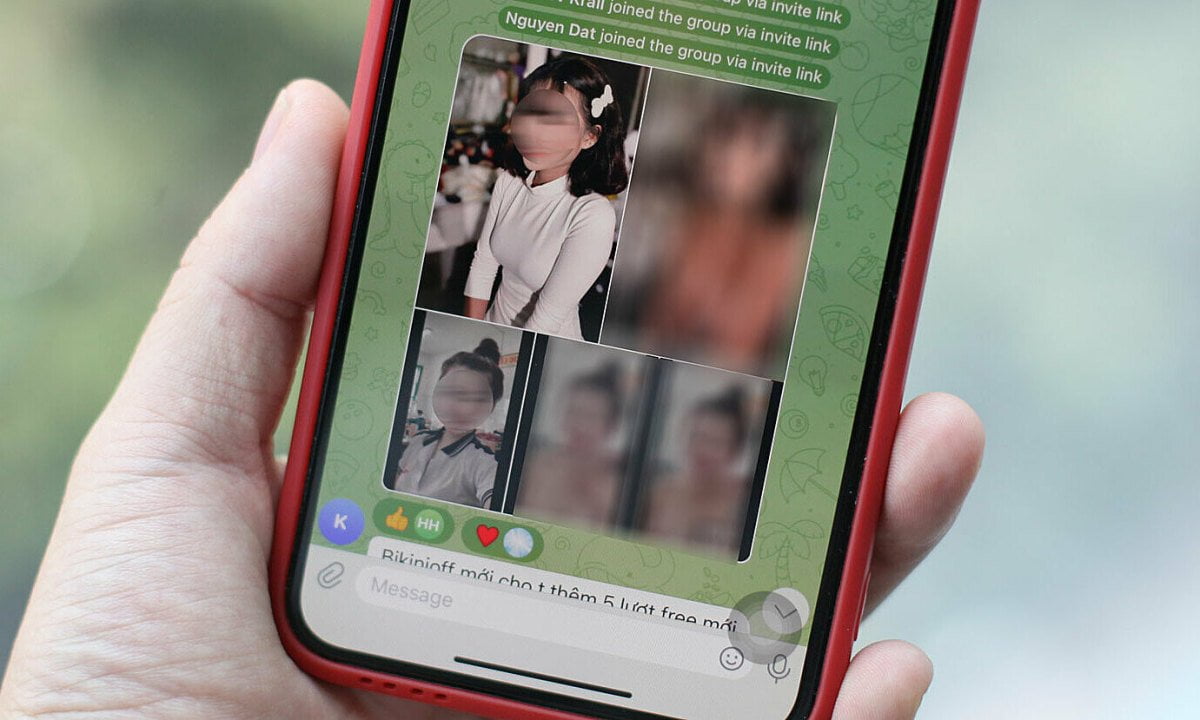

Nhóm chuyên cung cấp dịch vụ ảnh deepfake khiêu dâm trên Telegram, thu hút hàng nghìn người tham gia. Hình chụp: Khương Nha

“Mức độ phổ biến của dịch vụ ‘cởi quần áo’ bằng AI ngày càng tăng. Khả năng tiếp cận lượng người dùng lớn dẫn đến các nguy cơ gây hại trực tuyến khác như tạo và phát tán ảnh khỏa thân mà không có sự đồng ý của người dùng.” trong bức ảnh,” Sameweb nhóm nghiên cứu cho biết.

Theo các chuyên gia, giả sâu Những bức ảnh, video khỏa thân đã xuất hiện từ nhiều năm trước nhưng ở quy mô nhỏ do hạn chế về mặt kỹ thuật và cấu hình máy. Tuy nhiên, như AI Cơn sốt bùng nổ, chatbot ngày càng dễ sử dụng khiến nội dung này tràn ngập mạng xã hội. Chẳng hạn, hồi tháng 9, ảnh khỏa thân giả của hơn 20 nữ sinh lan truyền ở một số trường học ở Tây Ban Nha, gây chấn động cộng đồng. Dựa theo El País, các bức ảnh được xử lý bởi ứng dụng AI.

Instagram, TikTok, YouTube, Twitter và Facebook có chính sách “ngăn chặn thông tin sai lệch”. Tuy nhiên, hầu hết không thể kiểm soát được do lượng nội dung deepfake quá lớn. Trong khi đó, pháp luật chưa có chế tài cụ thể đối với hành vi giả mạo ảnh khiêu dâm.

Các nhà phát triển Super AI như OpenAI cũng tuyên bố loại bỏ nội dung khiêu dâm khỏi dữ liệu dùng để đào tạo Dall-E vẽ AI. giữa hành trình cũng chặn các từ khóa liên quan đến nội dung khiêu dâm, khuyến khích người dùng báo cáo nếu họ thấy nội dung nhạy cảm. Startup Stability AI cũng đã cập nhật phần mềm của mình vào tháng 11 năm 2022 để loại bỏ khả năng tạo hình ảnh tục tĩu trên Stable Diffusion. Tuy nhiên, người dùng luôn có cách lách luật và tạo ra những bức ảnh phản cảm.

Theo giáo sư Cailin O'Connor tại Đại học California, deepfake có thể gây hại như hình ảnh thật. “Mặc dù chúng là giả nhưng ấn tượng in sâu vào đầu người xem vẫn tồn tại. Nạn nhân của deepfake luôn phải nhận những ánh nhìn tò mò, chế giễu và thiếu tôn trọng”, giáo sư nói.

Khương Nha (dựa theo Thương nhân trong cuộc )

Trả lời

Bạn phải đăng nhập để gửi phản hồi.